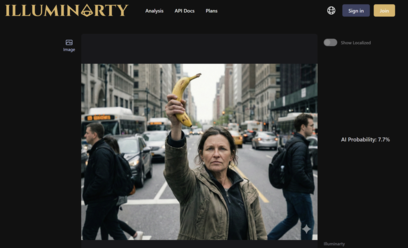

Melissa Sims esete megmutatta, hogy az ellenőrizetlen mesterséges intelligencia-tartalom milyen veszélyes lehet a jogrendszerben. Az iparág orvoslást ígér az úgynevezett "mesterséges intelligencia detektorok" formájában, amelyek olyan szoftverek, amelyek összetett algoritmusok segítségével felismerik, hogy egy kép emberi vagy gépi eredetű. Ezeknek a digitális őrszemeknek a megbízhatósága azonban továbbra is kérdéses, ha szándékos megtévesztéssel szembesülnek. A jelenleg legelterjedtebb hat felismerő szolgáltatással végzett kísérlet ezt tette próbára.

A tesztkép: Szürreális kihívás

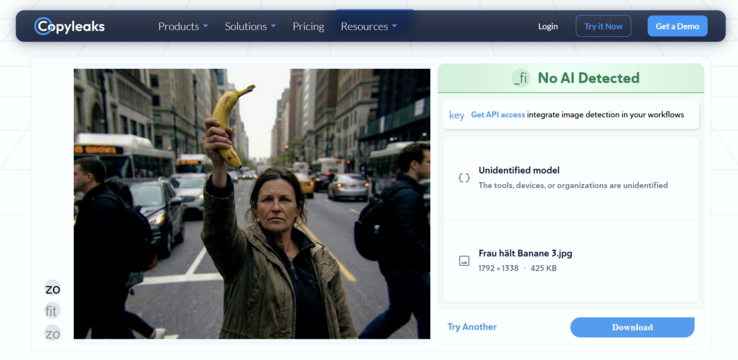

Az észlelőeszközök megmérettetésére a Google Gemini-alapú "Nano Banana Pro" képgenerátort használtuk A választott prompt szándékosan egyszerű, mégis kissé szeszélyes volt: "Egy nő, aki harci pózban tart egy banánt az ég felé. Háttér tipikus városkép érdektelen emberekkel"

Az automatizált felismerő szoftver első nagy akadálya azonban a felhasznált konkrét modellből ered. Mivel a Nano Banana Pro viszonylag új a piacon, sok detektor számára vakfoltot jelent.

Ezek a szolgáltatások gyakran a gépi tanulásra támaszkodnak, és kifejezetten arra vannak kiképezve, hogy felismerjék a bevált óriások, például a Midjourney, a DALL-E 3, a Stable Diffusion vagy a Flux egyedi aláírásait vagy "ujjlenyomatait". Következésképpen egy olyan friss modell, mint a Nano Banana Pro egyértelmű előnyben van, mivel a sajátos generációs mintái még nem részei a detektorok képzési adatainak, így könnyebben átcsúszhat a réseken.

1. forduló: kudarc a vízjelek ellenére

Az első lépésben a detektorok könnyű feladat elé néztek. Az eredeti PNG-t egyszerűen átalakították JPG formátumba, és a metaadatokat eltávolították. A legfontosabb, hogy a kép még mindig tartalmazott egy jól látható Gemini vízjelet.

Feltételezhetnénk, hogy a látható AI márkajelzés könnyű fogás a detektáló szoftverek számára. Az eredmény azonban kijózanító volt: a hat tesztelt eszközből kettő még ebben a nyers állapotban is kudarcot vallott. A nyilvánvaló vízjel ellenére alacsonyra értékelték annak valószínűségét, hogy a kép mesterséges intelligencia által generált.

» A Top 10 multimédiás noteszgép - tesztek alapján

» A Top 10 játékos noteszgép

» A Top 10 belépő szintű üzleti noteszgép

» A Top 10 üzleti noteszgép

» A Top 10 notebook munkaállomása

» A Top 10 okostelefon - tesztek alapján

» A Top 10 táblagép

» A Top 10 Windows tabletje

» A Top 10 subnotebook - tesztek alapján

» A Top 10 300 euró alatti okostelefonja

» A Top 10 120 euró alatti okostelefonja

» A Top 10 phabletje (>5.5-inch)

» A Top 10 noteszgép 500 EUR (~160.000 HUF) alatt

» A Top 10 "pehelysúlyú" gaming notebookja

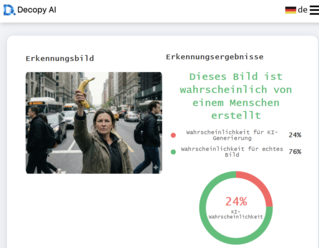

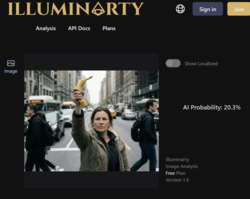

2. forduló: A digitális radír

A második lépésben közelebb kerültünk egy reális hamisítási forgatókönyvhöz. Az azonosító vízjelnek el kellett tűnnie. Az alapértelmezett Windows Photos alkalmazás beépített AI radírja néhány másodperc alatt gond nélkül elvégezte a feladatot.

Ennek az apró szerkesztésnek a hatása azonnali volt. Egy másik eszközt is becsaptak, amely most már alacsonyra minősítette a mesterséges intelligencia valószínűségét. Érdekes módon azonban az Illuminarty a szerkesztés után valóban növelte az AI által generált kép valószínűségi besorolását. Ennek ellenére a hat AI-felismerő eszköz közül három 30%-nál kisebb valószínűséggel állapította meg, hogy a banános nő mesterséges intelligenciával készült.

3. forduló: A tökéletlenség tökéletessége

Az utolsó lépés döntő volt. A mesterséges intelligenciával készült képek gyakran "túl simák" és túl tökéletesek a zajmentességükben. Ahhoz, hogy végül félrevezesse a detektorokat, a képnek mesterséges "valóságra", vagyis a digitális fényképezés tipikus hibáira volt szüksége. A Cyberlink PhotoDirector segítségével a képet utófeldolgozták. Enyhe lencsekorrekciót adtak hozzá, mesterséges kromatikus aberrációval színsávokat hoztak létre a széleken, növelték a kontrasztot, és ami a legfontosabb, valósághű képzajt fektettek a tájra. A cél az volt, hogy a kép úgy nézzen ki, mintha egy valódi, tökéletlen kamerával készült felvétel lenne. Mindez néhány perc alatt készült el.

Eredeti és feldolgozott kép összehasonlításban

Ennek a harmadik fordulónak az eredménye a felderítési technológia teljes veresége volt. Miután a kép átment ezen a szokásos utófeldolgozáson, mind a hat vizsgált szolgáltatás megadta magát. Egyetlen eszköz sem jelzett 5 százaléknál nagyobb AI-valószínűséget. A szoftver számára a banánra csapó nő most már kétségtelenül valódi fotó volt.

Ítélet: Veszélyes biztonságérzet

Kísérletünk élesen rávilágít arra, hogy a mesterséges intelligencia felismerésére szolgáló jelenlegi technikai megoldások még gyerekcipőben járnak. Ha csak néhány perc és egy szabványos képszerkesztő szoftver szükséges ahhoz, hogy a felismerési arányt a "nagyon valószínű" szintről "5 százalék alá" csökkentsük, akkor ezek az eszközök jelenleg nem csak a bíróságok, a szerkesztőségek vagy a bűnüldözés számára használhatatlanok - hanem veszélyesek is. Olyan hamis biztonságérzetet keltenek, amely egyszerűen nem létezik. A "bízz, de ellenőrizd" elv csak akkor működik, ha az ellenőrök nem vakok.